揭秘AI换脸黑科技引发全球恐慌

韩国再现“N号房”丑闻,这次的关键词是“深度伪造犯罪”。

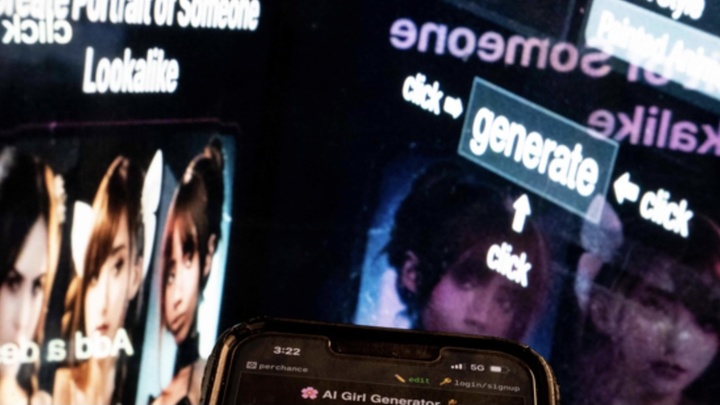

所谓“深度伪造犯罪”,即使用人工智能技术生成逼真的虚假内容,该技术的泛滥使得此次韩国女性的受害者数量以及相关色情图片视频的传播力度较之过去更上了一个台阶,受害者不得不在包括中国微博在内的各国社交平台发声,呼吁更多人关注。

深度伪造的技术原理是什么?黑灰产从业者如何从中牟利?为什么韩国最泛滥?应该如何加强监管?

AI深度伪造技术原理是什么?

对抗网络不断重复直到内容足够逼真

网络尖刀安全团队联合创始人蔡勇在接受记者采访时表示,AI深度伪造技术,也称为深度伪像(Deepfake),是一种利用人工智能技术生成逼真的虚假内容,通常是指用于伪造人物的视频、音频、图像等。其主要原理涉及两个关键技术:生成对抗网络(GANs)和深度学习。

“技术实现可以这么理解:首先,我们需要一个生成器和一个判别器。生成器的任务是模仿已有的真实内容,例如人的脸部特征,其通过学习大量的真实样本,比如照片或视频片段来生成看起来非常逼真的虚假内容。而判别器的任务是辨别生成器创建的内容是否真实。通过不断迭代训练,生成器和判别器会不断互相竞争、学习和提高。这种对抗性的过程不断重复,直到生成器生成的内容足够逼真,以至于人类很难分辨它们是虚假的。这就是为什么AI深度伪造技术可以制作出逼真的虚假视频、音频或图像的原因。”蔡勇说。

黑灰产打击专家丁健琮则告诉贝壳财经记者,Deepfake的核心原理是通过一定的图片识别算法将2D照片动态化,或将某张照片中的人脸植入到一段动态视频中。现在声纹伪造也逐步纳入了deepfake的概念。

随着近年来AI大模型技术的逐渐成熟,一些AI生图大模型在追求更多真实度的同时“误打误撞”成为了AI换脸或AI脱衣的帮凶,如此前著名的大模型stable diffusion就被开发出了一键脱衣的功能,并一度泛滥。虽然后来该大模型修改了相关功能,让这种行为有所收敛,但由于技术开源的特性,“潘多拉的盒子”已经打开,或许难以再度关闭。

来源:新京报 网络资源